ChatGPT es como Dorys de Buscando a Nemo

Un próximo salto vendrá cuando el público general (no técnico) pueda crear agentes de IA que entienda y retengan instrucciones y contextos específicos.

ChatGPT, Bing y Bard, y otros modelos generales de procesamiento de lenguaje natural son tremendamente poderosos en un rango increíble de tareas, pero tienen una limitación paradójica al momento de hacer tareas especializadas.

Esta es una situación paradójica, porque típicamente pensamos la tecnología y la automatización como herramientas para remplazar tareas repetitivas; pero esto no es el fuerte de ChatGPT. De hecho, es precisamente en estas situaciones donde las herramientas de chat tienden a ofrecer resultados menos satisfactorios.

Si necesitas que ChatGPT aprenda y siga una pauta específica, no siempre lo conseguirás de inmediato. Y cuando asimile la pauta tras varios intentos, olvidará lo que aprendió unas pocas interacciones más adelante.

Estas herramientas de chat hoy son como Dory de Buscando a Nemo con su pérdida de la memoria de corto plazo. Aunque son increíbles en el análisis y síntesis de información y en la generación de resultados, no retienen el contexto ni las instrucciones. La calidad del resultado para tareas especializadas es entonces limitado y poco fiable.

Para que estos modelos se conviertan en herramientas verdaderamente útiles en tareas especializadas es necesario poder adaptarlos a través de un proceso de entrenamiento focalizado en un dominio específico (fine-tuning). Esto implica alimentarlos con instrucciones, darle ejemplos del tipo de datos que ingresaremos (input) y del resultado esperado (output), así como entregarle un conjunto de datos (dataset) que les permita hacer bien una tarea concreta en un contexto específico. Y que no se olvide de ese entrenamiento.

Esto le permitirá entender la tarea específica que debe realizar, teniendo como resultado respuestas mucho más precisas.

Creo que un próximo salto en esta tecnología vendrá cuando se disponibilice para el público en general (no técnico) la capacidad de tener agentes especializados que puedas entrenar y que retengan las instrucciones y el contexto que le entregas. Algo de lo que hablé en este hilo. 🧵

Imagina tener un asistente personal de inteligencia artificial que pueda recordar y aprender de tus instrucciones específicas y que recuerde esto a lo largo de la interacciones.

Anexo: Ventana de contexto

Técnicamente esto se llama “ventana de contexto”. La cantidad de información que, por ejemplo, ChatGPT continuará recordando en una conversación.

Entonces, no importa si logras que en un punto te entienda al solicitarle tareas especializadas. A medida que avances en la conversación, y una vez pasada esa ventana de contexto, se olvidará de todo y continuará trabajando como modelo general, sin tener en cuenta lo que le dijiste antes.

Por eso, lo que hago cuando quiero usar un contexto específico muchas veces es copiar el texto con todo ese contexto y cambiar la instrucción/solicitud. Todo en una misma entrada.

¿De cuánto es la ventana de contexto en ChatGPT?

Si pagas por ChatGPT tienes acceso a una ventana de contexto de 8192 tokens (1). Algo así como 20 mil y 30 mil caracteres. Unas 8-10 páginas A4 con letras en tamaño 12.

En el caso de ChatGPT gratuito, que usa el modelo gpt-3.5 es la mitad de esto.

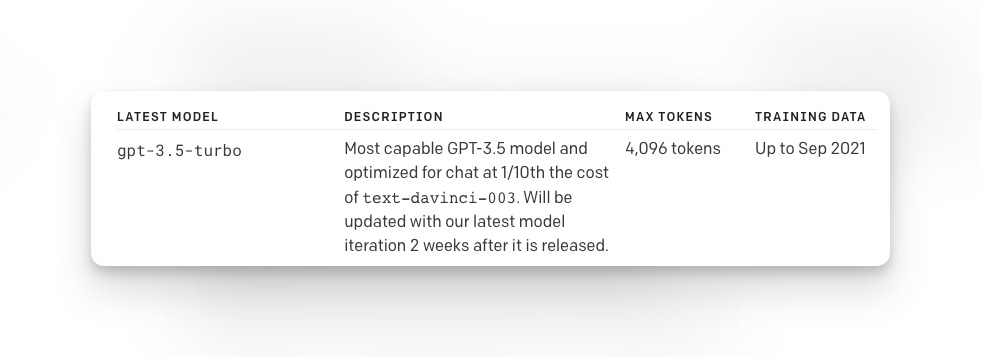

Puedes ver el tamaño de los modelos en el sitio de OpenAi y puedes ver la cantidad de tokens en su herramienta para eso.

Token: un token es la unidad mínima de texto que el modelo de GPT considera como una sola unidad para el procesamiento y la memoria.